أفضل 5 برامج LLM مفتوحة المصدر تحتاج إلى معرفتها [ديسمبر 2023]

نشرت: 2023-12-19ملخص:

استكشف طليعة ابتكارات الذكاء الاصطناعي مع أفضل 5 نماذج لغات كبيرة مفتوحة المصدر (LLMs) لعام 2023. بدءًا من معلمات Falcon الرائدة 180B إلى براعة BLOOM المتعددة اللغات، انغمس في الميزات المتطورة التي تشكل المستقبل. اكتشف نقاط القوة والتطبيقات المحتملة لـ Llama 2 وGPT-NeoX-20B وMPT-7B، مما يمكّن الشركات من التوسع بشكل آمن في مشهد الذكاء الاصطناعي المتطور.

مقدمة

إن عالم الذكاء الاصطناعي (AI) يتغير بسرعة، ويأتي جزء كبير من هذا التغيير من شيء يسمى نماذج اللغة الكبيرة (LLMs). هذه ليست مجرد أدوات عادية؛ إنهم مثل قادة مرحلة جديدة في التكنولوجيا. فكر فيها على أنها أنظمة ذكية حقًا تعمل على تغيير الطريقة التي نستخدم بها هواتفنا وأجهزة الكمبيوتر والأدوات الذكية الأخرى.

قد تختار المؤسسات برنامج LLM (نموذج اللغة الكبير) مفتوح المصدر بدلاً من الاعتماد على خدمات chatbot الخارجية مثل ChatGPT أو Claude.ai أو Phind لمعالجة مخاوف الخصوصية والأمان. يضمن تشغيل LLM مفتوح المصدر على جهازك بقاء البيانات الحساسة والمعلومات السرية تحت سيطرة المؤسسة، مما يقلل من مخاطر التعرض للكيانات الخارجية. يعد هذا النهج بالغ الأهمية بشكل خاص على الأنظمة الأساسية حيث يمكن للبشر مراجعة التفاعلات أو استخدامها لتدريب النماذج المستقبلية. من خلال الاستفادة من برامج LLM مفتوحة المصدر محليًا، يمكن للمؤسسة الحفاظ على مستوى أعلى من أمان البيانات وسريتها، ومعالجة مشكلات الخصوصية المحتملة المرتبطة بالتطبيقات الخارجية.

الأمر المثير هو أن العديد من برامج LLM هذه مفتوحة المصدر. وهذا يعني أن أي شخص لديه اهتمام وبعض المهارات التقنية يمكنه استخدامها وتغييرها وحتى تحسينها. إنه مثل وجود صديق ذكي للغاية يعمل بتقنية الذكاء الاصطناعي يمكنك التعلم منه وتعليمه حيلًا جديدة.

أفضل 5 ماجستير في إدارة الأعمال مفتوحة المصدر لعام 2023

في هذه المدونة، سنلقي نظرة على خمسة من هذه البرامج الرائعة مفتوحة المصدر LLM. كل واحدة منها مميزة بطريقتها الخاصة، حيث تقدم أفكارًا وقدرات جديدة لعالم الذكاء الاصطناعي.

فالكون إل إل إم

يعد Falcon LLM نموذجًا رائدًا للغات الكبيرة (LLM) تم تطويره بواسطة معهد الابتكار التكنولوجي (TII) في أبو ظبي. وهي مصممة لدفع التطبيقات وحالات الاستخدام، مما يضمن مرونة عالمنا في المستقبل. تشتمل المجموعة حاليًا على نماذج الذكاء الاصطناعي Falcon 180B و40B و7.5B و1.3B، إلى جانب مجموعة بيانات REFINEDWEB المنسقة بدقة. ويقدمون معًا مجموعة متنوعة وشاملة من الحلول.

فيما يلي تحليل شامل لميزاته الرئيسية ونقاط قوته واستخداماته المحتملة، بالإضافة إلى المصادر ذات الصلة لمزيد من الاستكشاف:

دلائل الميزات:

- حجم هائل : مع 180 مليار معلمة، يتميز Falcon 180B بقدرة رائعة على التعلم والأداء، متجاوزًا العديد من برامج LLM الأخرى مفتوحة المصدر.

- التدريب الفعال : تم التدريب على مجموعة بيانات منقحة مكونة من 3.5 تريليون رمز مميز، مما يضمن الدقة والجودة مع تحسين استخدام الموارد.

- التوفر مفتوح المصدر : الكود وبيانات التدريب متاحة للعامة على Hugging Face، مما يعزز الشفافية ومساهمات المجتمع.

- أداء فائق : تفوق Falcon على GPT-3 في العديد من المعايير بينما يتطلب قدرًا أقل من التدريب وموارد الاستدلال، مما يجعله خيارًا أكثر كفاءة.

- نماذج متنوعة : يقدم معهد دراسات الترجمة إصدارات مختلفة من Falcon، بما في ذلك نماذج الذكاء الاصطناعي 180B، و40B، و7.5B، و1.3B، ونماذج متخصصة لمهام محددة مثل كتابة القصة الطويلة.

نقاط القوة:

- خط بيانات عالي الجودة : تضمن عمليات تصفية البيانات وإلغاء البيانات المكررة الصارمة في معهد دراسات الترجمة الحصول على بيانات تدريب دقيقة وموثوقة لشركة Falcon.

- قدرات متعددة اللغات : يستطيع Falcon التعامل مع عدة لغات بفعالية، على الرغم من أن تركيزه الأساسي ينصب على اللغة الإنجليزية.

- إمكانية الضبط الدقيق : يمكن ضبط Falcon بدقة للقيام بمهام محددة، مما يعزز من أدائه وقدرته على التكيف.

- التطوير القائم على المجتمع : تسمح طبيعة المصدر المفتوح بإجراء تحسينات وأبحاث تعاونية، مما يؤدي إلى تسريع عملية تطوير Falcon.

التطبيقات المحتملة:

- معالجة اللغة الطبيعية (NLP): يستطيع Falcon التفوق في العديد من مهام البرمجة اللغوية العصبية مثل تلخيص النص، وتحليل المشاعر، وتوليد الحوار.

- إنشاء المحتوى الإبداعي : يمكن للنموذج أن يساعد الكتاب والفنانين في إنشاء تنسيقات إبداعية مختلفة مثل القصائد والنصوص والمقطوعات الموسيقية.

- التعليم والبحث : تجارب التعلم الشخصية، وتوليد المحتوى التعليمي، ودعم البحوث كلها تطبيقات محتملة.

- الأعمال والتسويق : يمكن لـ Falcon تشغيل روبوتات الدردشة الذكية وتخصيص الحملات التسويقية وتحليل بيانات العملاء بشكل فعال.

مصادر إضافية :

- موقع فالكون LLM: https://www.tii.ae/news/abu-dhabi-based-technology-innovation-institute-introduces-falcon-llm-foundational-large

- بطاقة نموذج صقر الوجه المعانق: https://huggingface.co/spaces/tiiuae/falcon-180b-demo

- مشاركة مدونة TII Falcon: https://huggingface.co/tiiuae/falcon-180B

- فيديو يوتيوب عن Falcon-180B: https://www.youtube.com/watch?v=9MArp9H2YCM

لاما 2

يعرض Llama 2، وهو نموذج لغة كبير مفتوح المصدر تم تطويره بواسطة Meta AI وMicrosoft، قدرات استثنائية في إنشاء محتوى متنوع، من القصائد إلى التعليمات البرمجية، والإجابة على الأسئلة، وترجمة اللغات. إنه يتفوق على ماجستير إدارة الأعمال الأخرى في معايير الاستدلال والترميز، مع التركيز على السلامة من خلال التعلم المعزز وتوفير "دليل الاستخدام المسؤول". وبينما لا يزال قيد التطوير، يجب أن يكون المستخدمون على دراية بأخطاء محتملة، ومخرجات متحيزة، والحاجة إلى الخبرة الفنية للاستخدام الأمثل. يعد الاستخدام المسؤول أمرًا بالغ الأهمية لإطلاق الإمكانات الكاملة لـ Llama 2 في إحداث ثورة في مختلف المجالات.

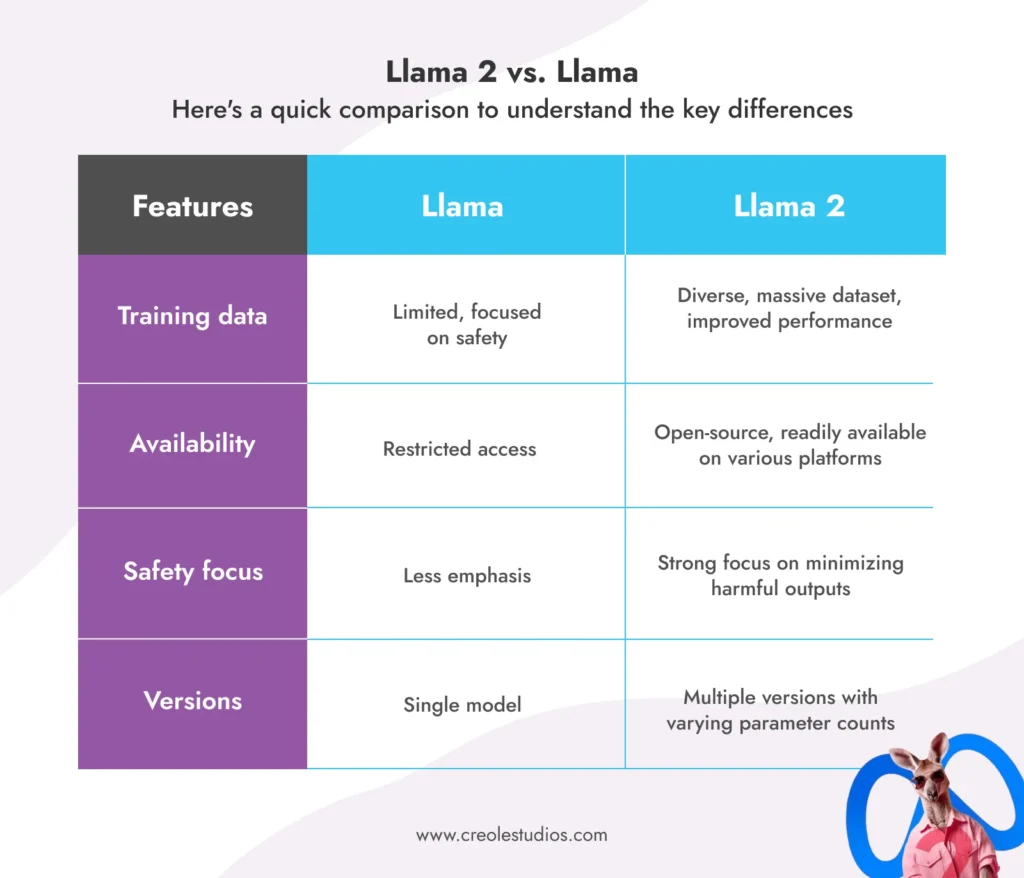

تم بناء Llama 2 على أساس اللاما الأصلية، وهي تتفوق على سابقتها بعدة طرق:

- تدريب متنوع : تم التدريب على مجموعة بيانات أكبر ومتنوعة، مما يضمن فهمًا وأداءً أفضل عبر المهام المختلفة.

- التوفر المفتوح : على عكس الوصول المحدود لسابقه، Llama 2 متاح بسهولة للبحث والتطوير وحتى التطبيقات التجارية على منصات مثل AWS وAzure وHugging Face.

- التركيز على السلامة : أعطت Meta الأولوية للسلامة من خلال تنفيذ تدابير لتقليل المعلومات الخاطئة والتحيز والمخرجات الضارة.

- التدريب المعزز : يتم تقديمه في إصدارات مختلفة مع عدد من المعلمات يتراوح من 7 مليار إلى 70 مليارًا، مما يلبي الاحتياجات والموارد المتنوعة.

اللاما 2 مقابل اللاما:

فيما يلي مقارنة سريعة لفهم الاختلافات الرئيسية:

التطبيقات المحتملة لللاما 2:

- روبوتات الدردشة والمساعدين الافتراضيين : يمكن لقدرات الحوار المحسنة أن تعزز التفاعلات الطبيعية والجذابة بشكل أكبر.

- إنشاء النص والمحتوى الإبداعي : قم بإنشاء تنسيقات إبداعية مختلفة مثل القصائد أو النصوص أو التعليمات البرمجية لمساعدة الكتاب والفنانين.

- إنشاء الأكواد البرمجية والبرمجة : مساعدة المطورين في مهام مثل إكمال الأكواد البرمجية واكتشاف الأخطاء.

- التعليم والبحث : تخصيص تجارب التعلم، وإنشاء محتوى تعليمي، ومساعدة الباحثين في المهام المختلفة.

- الأعمال والتسويق : تعزيز خدمة العملاء من خلال برامج الدردشة الآلية، وتخصيص الحملات التسويقية، وتحليل بيانات العملاء.

القيود والاعتبارات:

- مثل جميع شهادات LLM، لا يزال Llama 2 قيد التطوير ويمكن أن ينتج عنه مخرجات غير دقيقة أو متحيزة.

- الاستخدام المسؤول والأخلاقي أمر بالغ الأهمية لتجنب سوء الاستخدام والتحيز المحتمل.

- تتطلب الإصدارات المختلفة موارد حسابية مختلفة، لذا فإن اختيار الإصدار المناسب أمر مهم.

موارد:

- موقع Meta AI LLAMA: https://ai.meta.com/blog/large-language-model-llama-meta-ai/

- منشور مدونة Meta AI على LLAMA2: https://ai.meta.com/blog/large-language-model-llama-meta-ai/

- بطاقة نموذج Hugging Face LLAMA2: https://huggingface.co/models?search=llama

بلوم إل إل إم

لقد أصبحت Bloom LLM، التي ولدت نتيجة الجهود التعاونية للمجتمع العالمي، قوة حقيقية في مجال الذكاء الاصطناعي مفتوح المصدر. فيما يلي تفصيل شامل لميزاته الرئيسية وتطبيقاته المحتملة وما يجعله فريدًا:

ما هو بلوم إل إل إم؟

BLOOM عبارة عن LLM ضخمة ومتعددة اللغات، تضم 176 مليار معلمة ومدربة على 46 لغة مذهلة و13 لغة برمجة. تم تطوير BLOOM من خلال مشروع تعاوني لمدة عام يضم Hugging Face وباحثين من أكثر من 70 دولة، وهو يجسد روح الذكاء الاصطناعي مفتوح المصدر.

الميزات الرئيسية لبلوم:

- براعة متعددة اللغات : قم بإنشاء نص متماسك ودقيق بـ 46 لغة، متجاوزًا النماذج النموذجية التي تركز على اللغة الإنجليزية.

- الوصول مفتوح المصدر : كل من كود المصدر وبيانات التدريب متاحة للعامة، مما يعزز الشفافية والتحسين الذي يقوده المجتمع.

- إنشاء النص الانحداري التلقائي : يوسع ويكمل تسلسلات النص بسلاسة، مما يجعله مثاليًا لمختلف المهام الإبداعية والغنية بالمعلومات.

- عدد هائل من المعلمات : مع 176 مليار معلمة، تُصنف BLOOM من بين أقوى برامج LLM مفتوحة المصدر، مما يوفر أداءً فائقًا.

- التعاون العالمي : يجسد تطوير النموذج قوة التعاون الدولي في تطوير تكنولوجيا الذكاء الاصطناعي.

- إمكانية الوصول المجانية : يمكن لأي شخص الوصول إلى BLOOM والاستفادة منه من خلال منصة Hugging Face، مما يضفي طابعًا ديمقراطيًا على الوصول إلى أدوات الذكاء الاصطناعي المتطورة.

- التدريب على المستوى الصناعي : تم التدريب على كمية هائلة من البيانات النصية باستخدام موارد حسابية كبيرة، مما يضمن الأداء القوي.

التطبيقات المحتملة لبلوم:

- التواصل متعدد اللغات : تسهيل التواصل بين الثقافات من خلال ترجمة النصوص وإنشاء محتوى خاص باللغة.

- الكتابة الإبداعية وإنشاء المحتوى : مساعدة الكتاب والفنانين بتنسيقات مختلفة مثل القصائد والنصوص والأكواد والمقطوعات الموسيقية وما إلى ذلك.

- التعليم والبحث : تخصيص تجارب التعلم، وإنشاء المواد التعليمية، ودعم المساعي البحثية في مختلف المجالات.

- الأعمال والتسويق : تعزيز خدمة العملاء باستخدام روبوتات الدردشة متعددة اللغات، وتخصيص الحملات التسويقية، وتحليل البيانات بفعالية.

- تطوير الذكاء الاصطناعي مفتوح المصدر : بمثابة أساس لمزيد من البحث والتطوير في الذكاء الاصطناعي مفتوح المصدر، وتعزيز الابتكار المجتمعي.

ما الذي يجعل بلوم فريدًا؟

- التركيز على تعدد اللغات : على عكس العديد من شهادات LLM التي تركز بشكل أساسي على اللغة الإنجليزية، فإن قدرات BLOOM المتعددة اللغات تفتح إمكانيات جديدة للتواصل والتفاهم العالمي.

- الانفتاح والشفافية : يتيح وصول الجمهور إلى الكود وبيانات التدريب مشاركة أوسع في تحسين النموذج واستخدامه.

- التطوير التعاوني : يُظهر إنشاء النموذج من خلال التعاون العالمي إمكانات الذكاء الاصطناعي مفتوح المصدر لسد الحواجز الجغرافية والثقافية.

القيود والاعتبارات:

- كما هو الحال مع جميع شهادات LLM، لا يزال BLOOM قيد التطوير ويمكن أن ينتج عنه مخرجات غير دقيقة أو متحيزة. الاستخدام المسؤول والأخلاقي أمر بالغ الأهمية.

- يتطلب استخدام BLOOM بشكل فعال بعض المعرفة التقنية وفهم قدراته.

- قد يتطلب الحجم الكبير للنموذج موارد حسابية كبيرة لمهام معينة.

موارد:

- موقع BigScience BLOOM: https://huggingface.co/bigscience/bloom-intermediate

- بطاقة نموذج بلوم لوجه العناق: https://bigscience.huggingface.co/blog/bloom

- منشور مدونة BigScience على BLOOM: https://huggingface.co/bigscience/bloom

- مستودع بطاقة نموذج BLOOM على GitHub: https://github.com/bigscience-workshop/model_card

جي بي تي-نيوإكس-20بي

إنها شهادة LLM أخرى مفتوحة المصدر ترتفع إلى الصدارة، وتعرض قدرات وإمكانات رائعة. فيما يلي تفصيل لميزاته الرئيسية ونقاط قوته وتطبيقاته المحتملة:

ما هو جي بي تي-NeoX-20B؟

- تم تطوير GPT-NeoX-20B بواسطة EleutherAI، وهو عبارة عن نموذج لغة انحدار ذاتي مكون من 20 مليار معلمة تم تدريبه على Pile، وهي مجموعة بيانات ضخمة من النصوص والتعليمات البرمجية.

- تستعير هندستها المعمارية من GPT-3 ولكن مع تحسينات كبيرة لتحسين الأداء والكفاءة.

- يتفوق GPT-NeoX-20B في عدة مجالات:

- الاستدلال البسيط : يؤدي أداءً جيدًا بشكل استثنائي في المهام التي تتطلب فهم المعلومات وتطبيقها من أمثلة محدودة.

- إنشاء نص طويل : يُنشئ نصًا متماسكًا وصحيحًا نحويًا حتى بالنسبة للتسلسلات الطويلة.

- إنشاء التعليمات البرمجية وتحليلها : يمكنه فهم التعليمات البرمجية وإنشاءها، ومساعدة المطورين في المهام المختلفة.

نقاط قوة GPT-NeoX-20B:

- مفتوح المصدر : كود النموذج وأوزانه متاحة للعامة، مما يشجع مساهمات المجتمع والبحث.

- التدريب الفعال : يستخدم مكتبة DeepSpeed للتدريب الفعال، الذي يتطلب موارد حسابية أقل مقارنة ببرامج LLM الأخرى.

- التعلم القوي بعدد قليل من اللقطات : يؤدي أداءً جيدًا بشكل استثنائي في المهام ذات البيانات المحدودة، مما يجعله قابلاً للتكيف مع سيناريوهات متنوعة.

- إنشاء نص طويل الشكل : يُنشئ نصًا متماسكًا وصحيحًا نحويًا حتى بالنسبة للتسلسلات الطويلة، وهو مثالي للكتابة الإبداعية وإنشاء المحتوى.

- إنشاء التعليمات البرمجية وتحليلها : فهم التعليمات البرمجية وإنشائها، مما قد يساعد المطورين في اكتشاف الأخطاء وإكمال التعليمات البرمجية والمهام الأخرى.

التطبيقات المحتملة لـGPT-NeoX-20B:

- المساعدون الشخصيون وروبوتات الدردشة : تعزيز قدراتهم في فهم الأسئلة والطلبات المعقدة والرد عليها.

- الكتابة الإبداعية وتوليد المحتوى : مساعدة الكتاب والفنانين في إنشاء تنسيقات إبداعية مختلفة مثل القصائد والنصوص والمقطوعات الموسيقية وغيرها.

- التعليم والبحث : تخصيص تجارب التعلم، وإنشاء محتوى تعليمي، ودعم البحث في مختلف المجالات.

- تطوير البرمجيات : مساعدة المطورين في مهام مثل إكمال التعليمات البرمجية واكتشاف الأخطاء وتحليل التعليمات البرمجية.

- أبحاث الذكاء الاصطناعي مفتوحة المصدر : بمثابة أساس لمزيد من البحث والتطوير في الذكاء الاصطناعي مفتوح المصدر، وتعزيز الابتكار.

القيود والاعتبارات:

- كما هو الحال مع جميع شهادات LLM، لا يزال GPT-NeoX-20B قيد التطوير ويمكن أن ينتج عنه في بعض الأحيان مخرجات غير دقيقة أو متحيزة. الاستخدام المسؤول والأخلاقي أمر بالغ الأهمية.

- قد يتطلب استغلال إمكاناتها الكاملة بعض المعرفة التقنية وفهم قدراتها.

- قد يتطلب حجم النموذج موارد حسابية كبيرة لمهام معينة.

موارد:

- مستودع EleutherAI GitHub: هذا هو المستودع الرسمي لـ GPT-NeoX-20B، حيث يمكنك العثور على الكود المصدري والبرامج النصية للتدريب والنماذج المدربة مسبقًا. (المصدر: https://github.com/EleutherAI/gpt-neox)

- بطاقة نموذج Hugging Face: توفر بطاقة نموذج Hugging Face نظرة عامة شاملة على GPT-NeoX-20B، بما في ذلك قدراته وقيوده ونتائجه المعيارية. (المصدر: https://huggingface.co/EleutherAI/gpt-neox-20b)

- منشور مدونة EleutherAI: يقدم منشور المدونة هذا من EleutherAI GPT-NeoX-20B، ويناقش بنيته وعملية التدريب، ويسلط الضوء على بعض تطبيقاته المحتملة. (المصدر: https://www.opensourceforu.com/2022/04/eleutherai-releases-gpt-neox-20b-a-20-billion-parameter-ai-language-model/)

إم بي تي-7بي

MPT-7B ، وهو اختصار لـ MosaicML Pretrained Transformer، هو برنامج LLM قوي مفتوح المصدر تم تطويره بواسطة MosaicML Foundations. إنها تضم 7 مليار معلمة وتم تدريبها على مجموعة بيانات ضخمة مكونة من 1 تريليون رمز، مما يجعلها منافسًا قادرًا في مجال LLM. فيما يلي تفصيل لميزاته الرئيسية وتطبيقاته المحتملة، إلى جانب بعض المصادر ذات الصلة لمزيد من الاستكشاف:

دلائل الميزات:

- الترخيص التجاري : على عكس العديد من النماذج مفتوحة المصدر، تم ترخيص MPT-7B للاستخدام التجاري، مما يفتح الأبواب أمام الشركات للاستفادة من قدراتها.

- بيانات تدريب موسعة : يضمن تدريب MPT-7B على مجموعة بيانات متنوعة مكونة من 1 تريليون رمز أداءً قويًا وقدرة على التكيف عبر المهام المختلفة.

- معالجة الإدخال الطويلة : يمكن للنموذج التعامل مع المدخلات الطويلة بشكل استثنائي دون المساس بالدقة، مما يجعله مثاليًا لمهام مثل تلخيص المستندات الطويلة.

- السرعة والكفاءة : تم تحسين MPT-7B للتدريب والاستدلال السريع، ويقدم نتائج في الوقت المناسب، وهو أمر بالغ الأهمية لتطبيقات العالم الحقيقي.

- كود مفتوح المصدر : كود التدريب الفعال مفتوح المصدر الخاص بالنموذج يعزز الشفافية ويسهل مساهمات المجتمع في تطويره.

- التميز المقارن : أظهر MPT-7B أداءً فائقًا مقارنة بالنماذج الأخرى مفتوحة المصدر في نطاق المعلمات 7B-20B، حتى أنه يتوافق مع جودة LLaMA-7B.

التطبيقات المحتملة:

- التحليلات التنبؤية : يمكن لـ MPT-7B تحليل مجموعات البيانات الكبيرة لتحديد الأنماط والاتجاهات، وإبلاغ قرارات العمل وتحسين العمليات.

- دعم اتخاذ القرار : يمكن للنموذج أن يساعد في عمليات صنع القرار المعقدة من خلال تقديم رؤى وتوصيات بناءً على البيانات التي تم تحليلها.

- إنشاء المحتوى وتلخيصه : يمكن لـ MPT-7B إنشاء تنسيقات نصية إبداعية مختلفة مثل القصائد أو النصوص البرمجية أو التعليمات البرمجية، أو تلخيص المستندات الطويلة بفعالية.

- روبوتات الدردشة لخدمة العملاء : من خلال فهم اللغة الطبيعية والسياق، يمكن لـ MPT-7B تشغيل روبوتات الدردشة الذكية لتحسين تجارب خدمة العملاء.

- البحث والتطوير : يمكن للنموذج أن يدعم المساعي البحثية في مختلف المجالات من خلال تحليل البيانات، وتوليد الفرضيات، والمساعدة في الاستكشاف الإبداعي.

مصادر إضافية:

- موقع MosaicML MPT-7B: https://www.mosaicml.com/blog/mpt-7b

- بطاقة طراز Hugging Face MPT-7B: https://huggingface.co/mosaicml/mpt-7b

- منشور مدونة MosaicML على MPT-7B: https://www.mosaicml.com/blog/mpt-7b

استفد من شهادات LLM مفتوحة المصدر مع Creole Studios

تعمل نماذج اللغات الكبيرة مفتوحة المصدر (LLMs) على إعادة تشكيل الذكاء الاصطناعي، مما يوفر المرونة والابتكار للشركات. إنها رائعة لإنشاء حلول تقنية جديدة وخفض تكاليف التطوير. ومع ذلك، يمكن أن تكون التحديات مثل خصوصية البيانات والتخصيص لاحتياجات عمل محددة معقدة.

تعد Creole Studios شريكك المثالي في التغلب على هذه التحديات. إن خبرتنا في الذكاء الاصطناعي والتعلم الآلي تعني أنه بإمكاننا مساعدة عملك على استغلال الإمكانات الكاملة لبرامج LLM مفتوحة المصدر بكفاءة وأمان. نحن نركز على إنشاء حلول مصممة خصيصًا تتماشى مع أهدافك الفريدة، مما يضمن لك البقاء في المقدمة في مشهد الذكاء الاصطناعي سريع التطور.

كن شريكًا مع Creole Studios لتحويل رحلة الذكاء الاصطناعي الخاصة بك بقوة LLMs مفتوحة المصدر.