Die 5 besten Open-Source-LLMs, die Sie kennen müssen [Dezember 2023]

Veröffentlicht: 2023-12-19Zusammenfassung:

Entdecken Sie die Spitze der KI-Innovation mit den fünf besten Open-Source-LLMs (Large Language Models) des Jahres 2023. Von den bahnbrechenden 180B-Parametern von Falcon bis hin zu den Mehrsprachigkeitskompetenzen von BLOOM – tauchen Sie ein in die innovativen Funktionen, die die Zukunft gestalten werden. Entdecken Sie die Stärken und potenziellen Anwendungen von Llama 2, GPT-NeoX-20B und MPT-7B, die es Unternehmen ermöglichen, sicher in der sich entwickelnden KI-Landschaft zu skalieren.

Einführung

Die Welt der künstlichen Intelligenz (KI) verändert sich schnell und ein großer Teil dieser Veränderung ist auf sogenannte Large Language Models (LLMs) zurückzuführen. Dabei handelt es sich nicht nur um normale Werkzeuge; Sie sind wie die Anführer einer neuen Phase der Technologie. Betrachten Sie sie als wirklich intelligente Systeme, die die Art und Weise verändern, wie wir unsere Telefone, Computer und andere Geräte nutzen.

Unternehmen können sich für Open-Source-LLM-Software (Large Language Model) entscheiden, anstatt sich auf externe Chatbot-Dienste wie ChatGPT, Claude.ai oder Phind zu verlassen, um Datenschutz- und Sicherheitsbedenken auszuräumen. Durch die Ausführung eines Open-Source-LLM auf Ihrem Computer wird sichergestellt, dass sensible Daten und vertrauliche Informationen unter der Kontrolle des Unternehmens bleiben, wodurch das Risiko einer Gefährdung durch externe Einheiten minimiert wird. Dieser Ansatz ist besonders wichtig auf Plattformen, auf denen Interaktionen von Menschen überprüft oder zum Training zukünftiger Modelle verwendet werden können. Durch den lokalen Einsatz von Open-Source-LLM-Software kann ein Unternehmen ein höheres Maß an Datensicherheit und Vertraulichkeit aufrechterhalten und potenzielle Datenschutzprobleme im Zusammenhang mit externen Anwendungen angehen.

Das Spannende ist, dass viele dieser LLMs Open Source sind. Das bedeutet, dass jeder mit Interesse und einigen technischen Kenntnissen sie nutzen, ändern und sogar verbessern kann. Es ist, als hätte man einen superintelligenten KI-Freund, von dem man lernen und dem man neue Tricks beibringen kann.

Top 5 Opensource-LLMs von 2023

In diesem Blog werden wir uns fünf dieser erstaunlichen Open-Source-LLMs ansehen. Jeder einzelne ist auf seine Art besonders und bringt neue Ideen und Fähigkeiten in die Welt der KI.

Falcon LLM

Falcon LLM ist ein bahnbrechendes Large Language Model (LLM), das vom Technology Innovation Institute (TII) in Abu Dhabi entwickelt wurde. Es soll Anwendungen und Anwendungsfälle vorantreiben und die zukünftige Widerstandsfähigkeit unserer Welt sicherstellen. Die Suite umfasst derzeit die Parameter-KI-Modelle Falcon 180B, 40B, 7.5B und 1.3B sowie den sorgfältig kuratierten REFINEDWEB-Datensatz. Gemeinsam präsentieren sie ein vielfältiges und umfassendes Lösungsangebot.

Hier finden Sie eine umfassende Aufschlüsselung der wichtigsten Funktionen, Stärken und potenziellen Einsatzmöglichkeiten sowie relevante Quellen zur weiteren Erkundung:

Hauptmerkmale:

- Riesige Größe : Mit 180 Milliarden Parametern verfügt Falcon 180B über eine beeindruckende Lern- und Leistungsfähigkeit und übertrifft damit mehrere andere Open-Source-LLMs.

- Effizientes Training : Trainiert anhand eines verfeinerten Datensatzes von 3,5 Billionen Token, um Genauigkeit und Qualität zu gewährleisten und gleichzeitig die Ressourcennutzung zu optimieren.

- Open-Source-Verfügbarkeit : Der Code und die Trainingsdaten sind auf Hugging Face öffentlich verfügbar, was Transparenz und Community-Beiträge fördert.

- Überlegene Leistung : Falcon hat GPT-3 bei verschiedenen Benchmarks übertroffen und erfordert gleichzeitig weniger Schulungs- und Inferenzressourcen, was es zu einer effizienteren Option macht.

- Verschiedene Modelle : TII bietet verschiedene Falcon-Versionen an, darunter 180B-, 40B-, 7,5B- und 1,3B-Parameter-KI-Modelle sowie Spezialmodelle für bestimmte Aufgaben wie das Schreiben langer Geschichten.

Stärken:

- Hochwertige Datenpipeline : Die strengen Datenfilter- und Deduplizierungsprozesse von TII gewährleisten genaue und zuverlässige Trainingsdaten für Falcon.

- Mehrsprachige Fähigkeiten : Falcon kann mehrere Sprachen effektiv verarbeiten, obwohl sein Hauptaugenmerk auf Englisch liegt.

- Feinabstimmungspotenzial : Falcon kann für bestimmte Aufgaben feinabgestimmt werden, wodurch seine Leistung und Anpassungsfähigkeit weiter verbessert werden.

- Community-gesteuerte Entwicklung : Der Open-Source-Charakter ermöglicht gemeinsame Verbesserungen und Forschung und beschleunigt die Entwicklung von Falcon.

Anwendungsmöglichkeiten:

- Verarbeitung natürlicher Sprache (NLP): Falcon kann sich bei verschiedenen NLP-Aufgaben wie Textzusammenfassung, Stimmungsanalyse und Dialogerstellung auszeichnen.

- Generierung kreativer Inhalte : Das Modell kann Schriftstellern und Künstlern dabei helfen, verschiedene kreative Formate wie Gedichte, Drehbücher und Musikstücke zu erstellen.

- Bildung und Forschung : Mögliche Anwendungen sind personalisierte Lernerfahrungen, die Erstellung von Bildungsinhalten und Forschungsunterstützung.

- Geschäft und Marketing : Falcon kann intelligente Chatbots betreiben, Marketingkampagnen personalisieren und Kundendaten effektiv analysieren.

Zusätzliche Ressourcen :

- Website von Falcon LLM: https://www.tii.ae/news/abu-dhabi-based-technology-innovation-institute-introduces-falcon-llm-foundational-large

- Hugging Face Falcon-Modellkarte: https://huggingface.co/spaces/tiiuae/falcon-180b-demo

- TII Falcon-Blogbeitrag: https://huggingface.co/tiiuae/falcon-180B

- YouTube-Video zu Falcon-180B: https://www.youtube.com/watch?v=9MArp9H2YCM

Lama 2

Llama 2, ein von Meta AI und Microsoft entwickeltes Open-Source-Modell für große Sprachen, zeigt außergewöhnliche Fähigkeiten bei der Generierung vielfältiger Inhalte, von Gedichten bis hin zu Code, der Beantwortung von Fragen und der Übersetzung von Sprachen. Es übertrifft andere LLMs in Bezug auf Argumentations- und Codierungs-Benchmarks, indem es die Sicherheit durch verstärkendes Lernen betont und einen „Leitfaden zur verantwortungsvollen Nutzung“ bereitstellt. Während sich das Produkt noch in der Entwicklung befindet, sollten sich Benutzer möglicher Ungenauigkeiten, verzerrter Ergebnisse und der Notwendigkeit technischer Fachkenntnisse für eine optimale Nutzung bewusst sein. Eine verantwortungsvolle Nutzung ist von größter Bedeutung, um das volle Potenzial von Llama 2 auszuschöpfen und verschiedene Bereiche zu revolutionieren.

Llama 2 basiert auf dem Original-Llama und übertrifft seinen Vorgänger in mehrfacher Hinsicht:

- Vielfältiges Training : Trainiert anhand eines viel größeren und vielfältigeren Datensatzes, um ein besseres Verständnis und eine bessere Leistung bei verschiedenen Aufgaben zu gewährleisten.

- Offene Verfügbarkeit : Im Gegensatz zum eingeschränkten Zugriff seines Vorgängers ist Llama 2 für Forschung, Entwicklung und sogar kommerzielle Anwendungen auf Plattformen wie AWS, Azure und Hugging Face problemlos verfügbar.

- Sicherheitsfokus : Meta hat der Sicherheit Priorität eingeräumt, indem es Maßnahmen implementiert hat, um Fehlinformationen, Voreingenommenheit und schädliche Ergebnisse zu minimieren.

- Erweitertes Training : Wird in verschiedenen Versionen mit Parameterzahlen von 7 bis 70 Milliarden angeboten, um unterschiedlichen Anforderungen und Ressourcen gerecht zu werden.

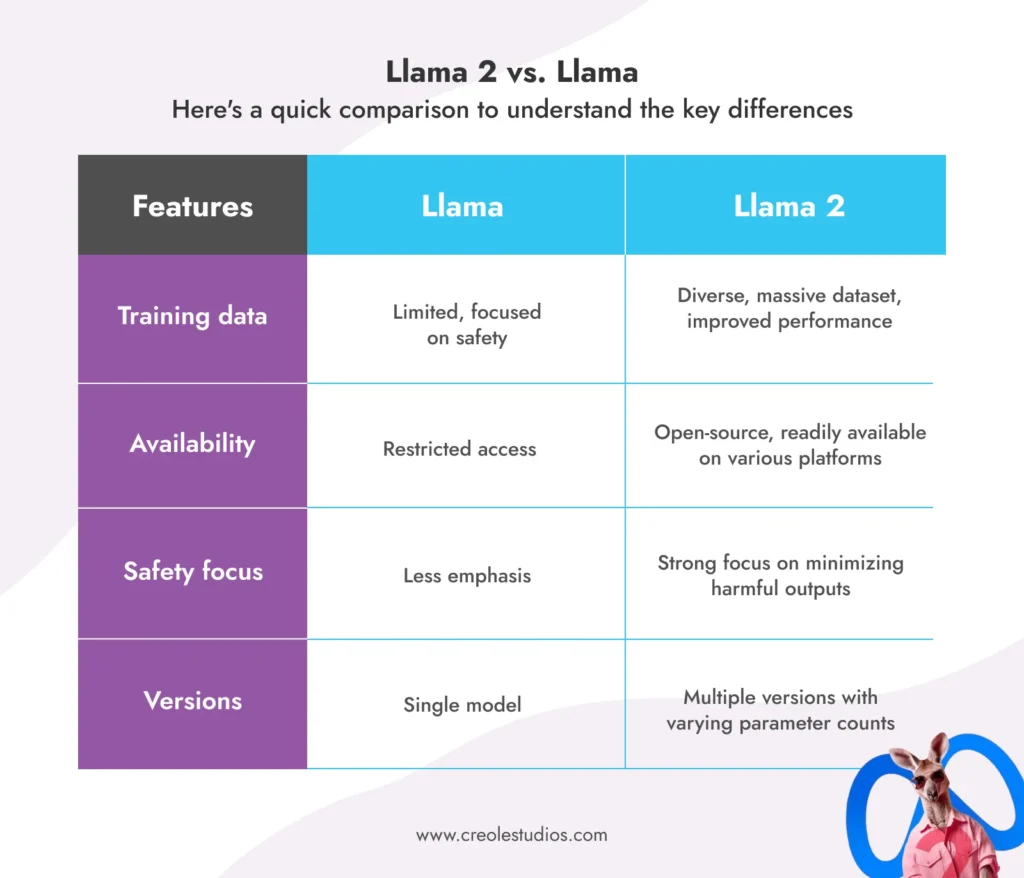

Lama 2 vs. Lama:

Hier ist ein kurzer Vergleich, um die wichtigsten Unterschiede zu verstehen:

Mögliche Anwendungen von Lama 2:

- Chatbots und virtuelle Assistenten : Verbesserte Dialogfähigkeiten können natürlichere und ansprechendere Interaktionen ermöglichen.

- Textgenerierung und kreative Inhalte : Generieren Sie verschiedene kreative Formate wie Gedichte, Skripte oder Code und unterstützen Sie so Autoren und Künstler.

- Codegenerierung und -programmierung : Helfen Sie Entwicklern bei Aufgaben wie Codevervollständigung und Fehlererkennung.

- Bildung und Forschung : Personalisieren Sie Lernerfahrungen, erstellen Sie Bildungsinhalte und unterstützen Sie Forscher bei verschiedenen Aufgaben.

- Geschäft und Marketing : Verbessern Sie den Kundenservice durch Chatbots, personalisieren Sie Marketingkampagnen und analysieren Sie Kundendaten.

Einschränkungen und Überlegungen:

- Wie alle LLMs befindet sich Llama 2 noch in der Entwicklung und kann ungenaue oder verzerrte Ergebnisse erzeugen.

- Eine verantwortungsvolle und ethische Nutzung ist von entscheidender Bedeutung, um potenziellen Missbrauch und Voreingenommenheit zu vermeiden.

- Verschiedene Versionen erfordern unterschiedliche Rechenressourcen, daher ist es wichtig, die richtige auszuwählen.

Ressourcen:

- Meta AI LLAMA-Website: https://ai.meta.com/blog/large-lingual-model-llama-meta-ai/

- Meta AI-Blogbeitrag zu LLAMA2: https://ai.meta.com/blog/large-lingual-model-llama-meta-ai/

- Hugging Face LLAMA2-Modellkarte: https://huggingface.co/models?search=llama

BLOOM LLM

Bloom LLM ist aus den gemeinsamen Anstrengungen einer globalen Gemeinschaft hervorgegangen und hat sich zu einer wahren Kraft in der Open-Source-KI-Landschaft entwickelt. Hier finden Sie eine umfassende Aufschlüsselung der wichtigsten Funktionen, potenziellen Anwendungen und der Besonderheiten:

Was ist BLOOM LLM?

BLOOM ist ein riesiges, mehrsprachiges LLM mit 176 Milliarden Parametern und trainiert in unglaublichen 46 Sprachen und 13 Programmiersprachen. BLOOM wurde im Rahmen eines einjährigen Gemeinschaftsprojekts von Hugging Face und Forschern aus über 70 Ländern entwickelt und verkörpert den Geist der Open-Source-KI.

Hauptmerkmale von BLOOM:

- Mehrsprachigkeit : Generieren Sie zusammenhängende und präzise Texte in satten 46 Sprachen, die über die typischen englischsprachigen Modelle hinausgehen.

- Open-Source-Zugriff : Sowohl der Quellcode als auch die Trainingsdaten sind öffentlich verfügbar, was Transparenz und von der Community vorangetriebene Verbesserungen fördert.

- Autoregressive Textgenerierung : Erweitert und vervollständigt Textsequenzen nahtlos und eignet sich daher ideal für verschiedene kreative und informative Aufgaben.

- Riesige Parameteranzahl : Mit 176 Milliarden Parametern zählt BLOOM zu den leistungsstärksten Open-Source-LLMs und bietet eine überragende Leistung.

- Globale Zusammenarbeit : Die Entwicklung des Modells veranschaulicht die Kraft der internationalen Zusammenarbeit bei der Weiterentwicklung der KI-Technologie.

- Kostenlose Zugänglichkeit : Jeder kann über die Hugging Face-Plattform auf BLOOM zugreifen und es nutzen, wodurch der Zugang zu modernsten KI-Tools demokratisiert wird.

- Training im industriellen Maßstab : Trainiert anhand einer großen Menge an Textdaten unter Einsatz erheblicher Rechenressourcen, um eine robuste Leistung sicherzustellen.

Mögliche Anwendungen von BLOOM:

- Mehrsprachige Kommunikation : Erleichtern Sie die interkulturelle Kommunikation durch die Übersetzung von Texten und die Generierung sprachspezifischer Inhalte.

- Kreatives Schreiben und Generierung von Inhalten : Unterstützen Sie Autoren und Künstler in verschiedenen Formaten wie Gedichten, Skripten, Code, Musikstücken usw.

- Bildung und Forschung : Personalisieren Sie Lernerfahrungen, erstellen Sie Lehrmaterialien und unterstützen Sie Forschungsbemühungen in verschiedenen Bereichen.

- Geschäft und Marketing : Verbessern Sie den Kundenservice mit mehrsprachigen Chatbots, personalisieren Sie Marketingkampagnen und analysieren Sie Daten effektiv.

- Open-Source-KI-Entwicklung : Dient als Grundlage für weitere Forschung und Entwicklung im Bereich Open-Source-KI und fördert die Innovation der Gemeinschaft.

Was macht BLOOM einzigartig?

- Mehrsprachiger Fokus : Im Gegensatz zu vielen LLMs, die sich hauptsächlich auf Englisch konzentrieren, eröffnen die mehrsprachigen Fähigkeiten von BLOOM neue Möglichkeiten für globale Kommunikation und Verständigung.

- Offenheit und Transparenz : Der öffentliche Zugriff auf den Code und die Trainingsdaten ermöglicht eine breitere Beteiligung an der Verbesserung und Nutzung des Modells.

- Kollaborative Entwicklung : Die Erstellung des Modells durch globale Zusammenarbeit zeigt das Potenzial von Open-Source-KI zur Überbrückung geografischer und kultureller Barrieren.

Einschränkungen und Überlegungen:

- Wie alle LLMs befindet sich BLOOM noch in der Entwicklung und kann zu ungenauen oder verzerrten Ergebnissen führen. Ein verantwortungsvoller und ethischer Umgang ist von entscheidender Bedeutung.

- Die effektive Nutzung von BLOOM erfordert einige technische Kenntnisse und ein Verständnis seiner Fähigkeiten.

- Aufgrund der Größe des Modells sind für bestimmte Aufgaben möglicherweise erhebliche Rechenressourcen erforderlich.

Ressourcen:

- BigScience BLOOM-Website: https://huggingface.co/bigscience/bloom-intermediate

- Hugging Face BLOOM-Modellkarte: https://bigscience.huggingface.co/blog/bloom

- BigScience-Blogbeitrag auf BLOOM: https://huggingface.co/bigscience/bloom

- BLOOM-Modellkarten-Repository auf GitHub: https://github.com/bigscience-workshop/model_card

GPT-NeoX-20B

Es handelt sich um ein weiteres Open-Source-LLM, das immer mehr an Bedeutung gewinnt und bemerkenswerte Fähigkeiten und Potenziale aufweist. Hier finden Sie eine Aufschlüsselung der wichtigsten Funktionen, Stärken und potenziellen Anwendungen:

Was ist GPT-NeoX-20B?

- GPT-NeoX-20B wurde von EleutherAI entwickelt und ist ein autoregressives Sprachmodell mit 20 Milliarden Parametern, das auf dem Pile, einem riesigen Datensatz aus Text und Code, trainiert wurde.

- Seine Architektur lehnt sich an GPT-3 an, weist jedoch erhebliche Optimierungen für verbesserte Leistung und Effizienz auf.

- GPT-NeoX-20B zeichnet sich in mehreren Bereichen aus:

- Argumentation mit wenigen Stichproben : Erbringt außerordentlich gute Ergebnisse bei Aufgaben, die das Verstehen und Anwenden von Informationen aus begrenzten Beispielen erfordern.

- Generierung von Texten in Langform : Erzeugt kohärenten und grammatikalisch korrekten Text auch bei längeren Textsequenzen.

- Codegenerierung und -analyse : Kann Code verstehen und generieren und Entwickler bei verschiedenen Aufgaben unterstützen.

Stärken von GPT-NeoX-20B:

- Open-Source : Der Code und die Gewichte des Modells sind öffentlich verfügbar, was zu Beiträgen und Forschung in der Community anregt.

- Effizientes Training : Nutzt die DeepSpeed-Bibliothek für effizientes Training und erfordert im Vergleich zu anderen LLMs weniger Rechenressourcen.

- Starkes Wenig-Schuss-Lernen : Funktioniert außergewöhnlich gut bei Aufgaben mit begrenzten Daten und ist daher an verschiedene Szenarien anpassbar.

- Generierung von Texten in Langform : Erzeugt kohärenten und grammatikalisch korrekten Text auch bei langen Textsequenzen, ideal für kreatives Schreiben und die Generierung von Inhalten.

- Codegenerierung und -analyse : Versteht und generiert Code und unterstützt Entwickler möglicherweise bei der Fehlererkennung, Codevervollständigung und anderen Aufgaben.

Mögliche Anwendungen von GPT-NeoX-20B:

- Persönliche Assistenten und Chatbots : Verbessern Sie ihre Fähigkeiten beim Verstehen und Beantworten komplexer Fragen und Anfragen.

- Kreatives Schreiben und Generieren von Inhalten : Unterstützen Sie Autoren und Künstler bei der Erstellung verschiedener kreativer Formate wie Gedichte, Drehbücher, Musikstücke usw.

- Bildung und Forschung : Personalisieren Sie Lernerfahrungen, generieren Sie Bildungsinhalte und unterstützen Sie die Forschung in verschiedenen Bereichen.

- Softwareentwicklung : Unterstützen Sie Entwickler bei Aufgaben wie Code-Vervollständigung, Fehlererkennung und Code-Analyse.

- Open-Source-KI-Forschung : Dient als Grundlage für weitere Forschung und Entwicklung im Bereich Open-Source-KI und fördert Innovationen.

Einschränkungen und Überlegungen:

- Wie alle LLMs befindet sich GPT-NeoX-20B noch in der Entwicklung und kann manchmal ungenaue oder verzerrte Ausgaben erzeugen. Ein verantwortungsvoller und ethischer Umgang ist von entscheidender Bedeutung.

- Um sein volles Potenzial auszuschöpfen, sind möglicherweise einige technische Kenntnisse und ein Verständnis seiner Fähigkeiten erforderlich.

- Aufgrund der Größe des Modells sind für bestimmte Aufgaben möglicherweise erhebliche Rechenressourcen erforderlich.

Ressourcen:

- EleutherAI GitHub-Repository: Dies ist das offizielle Repository für GPT-NeoX-20B, in dem Sie den Quellcode, Trainingsskripte und vorab trainierte Modelle finden. (Quelle: https://github.com/EleutherAI/gpt-neox)

- Hugging Face-Modellkarte: Die Hugging Face-Modellkarte bietet einen umfassenden Überblick über GPT-NeoX-20B, einschließlich seiner Fähigkeiten, Einschränkungen und Benchmark-Ergebnisse. (Quelle: https://huggingface.co/EleutherAI/gpt-neox-20b)

- EleutherAI-Blogbeitrag: In diesem Blogbeitrag von EleutherAI wird GPT-NeoX-20B vorgestellt, seine Architektur und sein Trainingsprozess erörtert und einige seiner potenziellen Anwendungen hervorgehoben. (Quelle: https://www.opensourceforu.com/2022/04/eleutherai-releases-gpt-neox-20b-a-20-billion-parameter-ai-lingual-model/)

MPT-7B

MPT-7B , die Abkürzung für „MosaicML Pretrained Transformer“, ist ein leistungsstarkes Open-Source-LLM, das von MosaicML Foundations entwickelt wurde. Es verfügt über 7 Milliarden Parameter und wird auf einem riesigen Datensatz von 1 Billion Token trainiert, was es zu einem fähigen Konkurrenten in der LLM-Landschaft macht. Hier finden Sie eine Aufschlüsselung der wichtigsten Funktionen und potenziellen Anwendungen sowie einige relevante Quellen zur weiteren Erkundung:

Hauptmerkmale:

- Kommerzielle Lizenzierung : Im Gegensatz zu vielen Open-Source-Modellen ist MPT-7B für die kommerzielle Nutzung lizenziert und eröffnet Unternehmen die Möglichkeit, seine Fähigkeiten zu nutzen.

- Umfangreiche Trainingsdaten : Das Training des MPT-7B anhand eines vielfältigen Datensatzes von 1 Billion Token gewährleistet eine robuste Leistung und Anpassungsfähigkeit bei verschiedenen Aufgaben.

- Verarbeitung langer Eingaben : Das Modell kann außergewöhnlich lange Eingaben verarbeiten, ohne die Genauigkeit zu beeinträchtigen, was es ideal für Aufgaben wie das Zusammenfassen langer Dokumente macht.

- Geschwindigkeit und Effizienz : MPT-7B ist für schnelles Training und Inferenz optimiert und liefert zeitnahe Ergebnisse, die für reale Anwendungen von entscheidender Bedeutung sind.

- Open-Source-Code : Der effiziente Open-Source-Trainingscode des Modells fördert die Transparenz und erleichtert Community-Beiträge zu seiner Entwicklung.

- Vergleichende Exzellenz : MPT-7B hat im Vergleich zu anderen Open-Source-Modellen im Parameterbereich 7B-20B eine überlegene Leistung gezeigt und erreicht sogar die Qualität von LLaMA-7B.

Anwendungsmöglichkeiten:

- Prädiktive Analysen : MPT-7B kann große Datensätze analysieren, um Muster und Trends zu erkennen, Geschäftsentscheidungen zu treffen und Abläufe zu optimieren.

- Entscheidungsunterstützung : Das Modell kann bei komplexen Entscheidungsprozessen helfen, indem es Erkenntnisse und Empfehlungen auf der Grundlage analysierter Daten liefert.

- Inhaltsgenerierung und -zusammenfassung : MPT-7B kann verschiedene kreative Textformate wie Gedichte, Skripte oder Code generieren oder lange Dokumente effektiv zusammenfassen.

- Kundendienst-Chatbots : Durch das Verständnis natürlicher Sprache und des Kontexts kann MPT-7B intelligente Chatbots für ein verbessertes Kundendiensterlebnis bereitstellen.

- Forschung und Entwicklung : Das Modell kann Forschungsbemühungen in verschiedenen Bereichen unterstützen, indem es Daten analysiert, Hypothesen generiert und bei der kreativen Erkundung hilft.

Zusätzliche Ressourcen:

- MosaikML MPT-7B-Website: https://www.mosaicml.com/blog/mpt-7b

- Hugging Face MPT-7B-Modellkarte: https://huggingface.co/mosaicml/mpt-7b

- MosaikML-Blogbeitrag zu MPT-7B: https://www.mosaicml.com/blog/mpt-7b

Nutzen Sie OpenSource-LLMs mit Creole Studios

Opensource Large Language Models (LLMs) gestalten die KI neu und bieten Flexibilität und Innovation für Unternehmen. Sie eignen sich hervorragend zur Entwicklung neuer technischer Lösungen und zur Senkung der Entwicklungskosten. Herausforderungen wie Datenschutz und Anpassung an spezifische Geschäftsanforderungen können jedoch komplex sein.

Creole Studios ist Ihr idealer Partner bei der Bewältigung dieser Herausforderungen. Dank unserer Expertise in den Bereichen KI und maschinelles Lernen können wir Ihrem Unternehmen dabei helfen, das volle Potenzial von Open-Source-LLMs effizient und sicher auszuschöpfen. Wir konzentrieren uns auf die Entwicklung maßgeschneiderter Lösungen, die auf Ihre individuellen Ziele abgestimmt sind und sicherstellen, dass Sie in der sich schnell entwickelnden KI-Landschaft die Nase vorn haben.

Arbeiten Sie mit Creole Studios zusammen, um Ihre KI-Reise mit der Leistungsfähigkeit von Open-Source-LLMs zu transformieren.