5 LLM Open-Source Teratas yang perlu Anda ketahui [Desember 2023]

Diterbitkan: 2023-12-19Ringkasan:

Jelajahi garis depan inovasi AI dengan 5 Model Bahasa Besar (LLM) sumber terbuka teratas pada tahun 2023. Dari parameter 180B yang inovatif dari Falcon hingga kehebatan multibahasa BLOOM, selidiki fitur-fitur mutakhir yang membentuk masa depan. Temukan kekuatan dan potensi penerapan Llama 2, GPT-NeoX-20B, dan MPT-7B, yang memberdayakan bisnis untuk melakukan skala dengan aman dalam lanskap AI yang terus berkembang.

Perkenalan

Dunia kecerdasan buatan (AI) berubah dengan cepat, dan sebagian besar perubahan tersebut berasal dari sesuatu yang disebut Model Bahasa Besar (LLM). Ini bukan sekadar alat biasa; mereka seperti pemimpin fase baru dalam teknologi. Anggap saja mereka sebagai sistem yang sangat cerdas yang mengubah cara kita menggunakan ponsel, komputer, dan gadget lainnya.

Perusahaan dapat memilih perangkat lunak LLM (Model Bahasa Besar) sumber terbuka daripada mengandalkan layanan chatbot eksternal seperti ChatGPT, Claude.ai, atau Phind untuk mengatasi masalah privasi dan keamanan. Menjalankan LLM sumber terbuka di mesin Anda memastikan bahwa data sensitif dan informasi rahasia tetap berada dalam kendali perusahaan, meminimalkan risiko paparan terhadap entitas eksternal. Pendekatan ini sangat penting pada platform di mana interaksi dapat ditinjau oleh manusia atau digunakan untuk melatih model masa depan. Dengan memanfaatkan perangkat lunak LLM sumber terbuka secara lokal, perusahaan dapat menjaga tingkat keamanan dan kerahasiaan data yang lebih tinggi, mengatasi potensi masalah privasi yang terkait dengan aplikasi eksternal.

Yang menarik adalah banyak dari LLM ini bersumber terbuka. Artinya, siapa pun yang memiliki minat dan keahlian teknologi dapat menggunakannya, mengubahnya, dan bahkan meningkatkannya. Ini seperti memiliki teman AI super pintar yang dapat Anda pelajari dan ajarkan trik-trik baru.

5 LLM Opensource Teratas tahun 2023

Di blog ini, kita akan melihat lima LLM sumber terbuka yang menakjubkan ini. Masing-masing memiliki keunikannya masing-masing, membawa ide dan kemampuan baru ke dunia AI.

Falcon LLM

Falcon LLM berdiri sebagai model bahasa besar (LLM) inovatif yang dikembangkan oleh Institut Inovasi Teknologi (TII) di Abu Dhabi. Hal ini dirancang untuk mendorong aplikasi dan kasus penggunaan, memastikan ketahanan masa depan dunia kita. Rangkaian tersebut saat ini mencakup model AI parameter Falcon 180B, 40B, 7.5B, dan 1.3B, bersama dengan kumpulan data REFINEDWEB yang dikurasi dengan cermat. Bersama-sama, mereka menghadirkan serangkaian solusi yang beragam dan komprehensif.

Berikut rincian komprehensif fitur utama, kekuatan, dan potensi kegunaannya, serta sumber relevan untuk eksplorasi lebih lanjut:

Fitur Utama:

- Ukuran Besar : Dengan 180 miliar parameter, Falcon 180B menawarkan kapasitas pembelajaran dan kinerja yang mengesankan, melampaui beberapa LLM sumber terbuka lainnya.

- Pelatihan Efisien : Dilatih pada kumpulan data 3,5 triliun token yang disempurnakan, memastikan akurasi dan kualitas sekaligus mengoptimalkan penggunaan sumber daya.

- Ketersediaan Sumber Terbuka : Kode dan data pelatihan tersedia untuk umum di Hugging Face, mendorong transparansi dan kontribusi komunitas.

- Performa Unggul : Falcon telah mengungguli GPT-3 pada berbagai tolok ukur, namun memerlukan lebih sedikit sumber daya pelatihan dan inferensi, sehingga menjadikannya pilihan yang lebih efisien.

- Beragam Model : TII menawarkan berbagai versi Falcon, termasuk model AI parameter 180B, 40B, 7.5B, 1.3B, model khusus untuk tugas spesifik seperti penulisan cerita berdurasi panjang.

Kekuatan:

- Saluran data berkualitas tinggi : Proses penyaringan dan deduplikasi data TII yang ketat memastikan data pelatihan yang akurat dan andal untuk Falcon.

- Kemampuan multibahasa : Falcon dapat menangani berbagai bahasa secara efektif, meskipun fokus utamanya adalah bahasa Inggris.

- Potensi penyempurnaan : Falcon dapat disesuaikan untuk tugas-tugas tertentu, sehingga semakin meningkatkan kinerja dan kemampuan beradaptasinya.

- Pembangunan berbasis komunitas : Sifat sumber terbuka memungkinkan peningkatan dan penelitian kolaboratif, sehingga mempercepat pengembangan Falcon.

Aplikasi Potensial:

- Pemrosesan bahasa alami (NLP): Falcon dapat unggul dalam berbagai tugas NLP seperti peringkasan teks, analisis sentimen, dan pembuatan dialog.

- Pembuatan konten kreatif : Model ini dapat membantu penulis dan seniman dalam menghasilkan berbagai format kreatif seperti puisi, naskah, dan karya musik.

- Pendidikan dan penelitian : Pengalaman pembelajaran yang dipersonalisasi, pembuatan konten pendidikan, dan dukungan penelitian merupakan penerapan yang potensial.

- Bisnis dan pemasaran : Falcon dapat mendukung chatbot cerdas, mempersonalisasi kampanye pemasaran, dan menganalisis data pelanggan secara efektif.

Sumber daya tambahan :

- Situs web Falcon LLM: https://www.tii.ae/news/abu-dhabi-based-technology-innovation-institute-introduces-falcon-llm-foundational-large

- Kartu model Hugging Face Falcon: https://huggingface.co/spaces/tiiuae/falcon-180b-demo

- Entri blog TII Falcon: https://huggingface.co/tiiuae/falcon-180B

- Video YouTube di Falcon-180B: https://www.youtube.com/watch?v=9MArp9H2YCM

LAMA 2

Llama 2, model bahasa besar sumber terbuka yang dikembangkan oleh Meta AI dan Microsoft, menampilkan kemampuan luar biasa dalam menghasilkan beragam konten, mulai dari puisi hingga kode, menjawab pertanyaan, dan menerjemahkan bahasa. Ini mengungguli LLM lain dalam tolok ukur penalaran dan pengkodean, menekankan keselamatan melalui pembelajaran penguatan dan menyediakan “Panduan Penggunaan yang Bertanggung Jawab.” Meskipun masih dalam pengembangan, pengguna harus mewaspadai potensi ketidakakuratan, keluaran yang bias, dan kebutuhan akan keahlian teknis untuk penggunaan yang optimal. Pemanfaatan yang bertanggung jawab sangat penting untuk membuka potensi penuh Llama 2 dalam merevolusi berbagai bidang.

Dibangun berdasarkan Llama asli, Llama 2 melampaui pendahulunya dalam beberapa hal:

- Pelatihan Beragam : Dilatih pada kumpulan data yang jauh lebih besar dan bervariasi, memastikan pemahaman dan kinerja yang lebih baik di berbagai tugas.

- Ketersediaan Terbuka : Berbeda dengan akses terbatas pendahulunya, Llama 2 tersedia untuk penelitian, pengembangan, dan bahkan aplikasi komersial pada platform seperti AWS, Azure, dan Hugging Face.

- Fokus Keamanan : Meta telah memprioritaskan keselamatan dengan menerapkan langkah-langkah untuk meminimalkan misinformasi, bias, dan keluaran yang merugikan.

- Pelatihan yang Ditingkatkan : Ditawarkan dalam versi berbeda dengan jumlah parameter berkisar antara 7 miliar hingga 70 miliar, memenuhi beragam kebutuhan dan sumber daya.

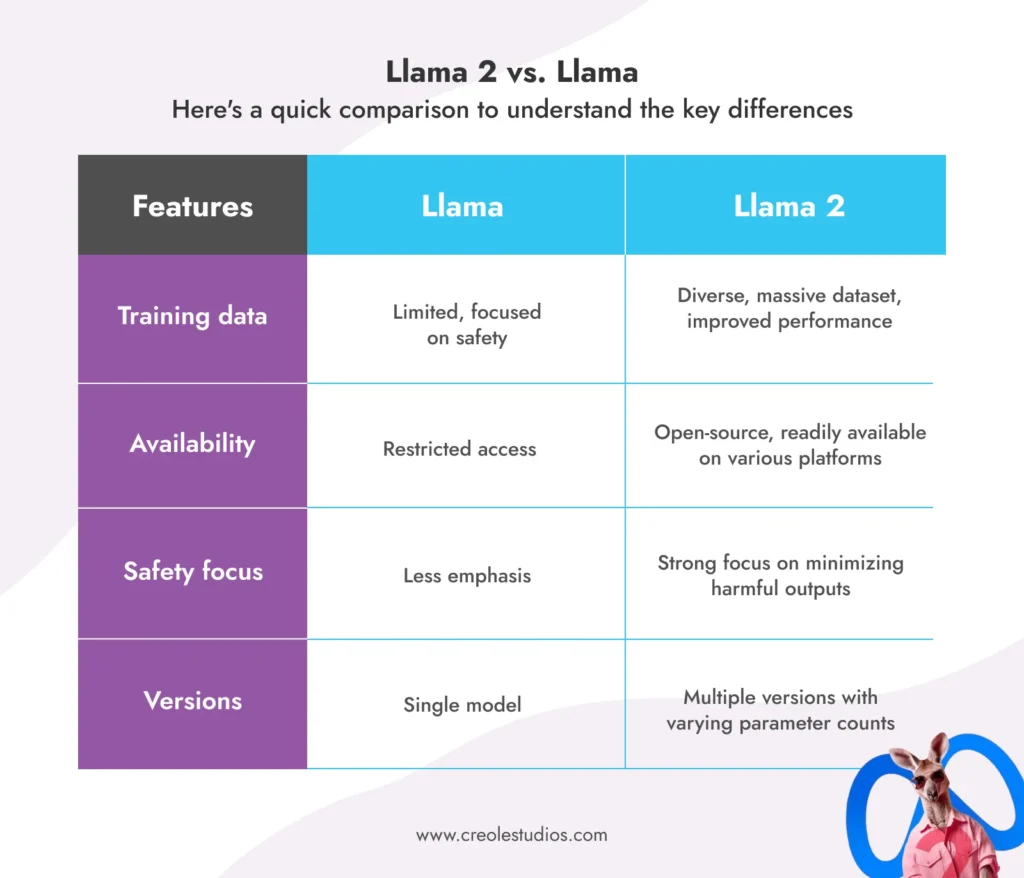

Llama 2 vs.Llama:

Berikut perbandingan singkat untuk memahami perbedaan utama:

Potensi Penerapan Llama 2:

- Chatbots dan Asisten Virtual : Peningkatan kemampuan dialog dapat mendorong interaksi yang lebih alami dan menarik.

- Pembuatan Teks dan Konten Kreatif : Menghasilkan berbagai format kreatif seperti puisi, skrip, atau kode, membantu penulis dan seniman.

- Pembuatan Kode dan Pemrograman : Membantu pengembang dengan tugas-tugas seperti penyelesaian kode dan deteksi bug.

- Pendidikan dan Penelitian : Personalisasi pengalaman belajar, menghasilkan konten pendidikan, dan membantu peneliti dengan berbagai tugas.

- Bisnis dan Pemasaran : Meningkatkan layanan pelanggan melalui chatbots, mempersonalisasi kampanye pemasaran, dan menganalisis data pelanggan.

Keterbatasan dan Pertimbangan:

- Seperti semua LLM, Llama 2 masih dalam pengembangan dan dapat menghasilkan keluaran yang tidak akurat atau bias.

- Penggunaan yang bertanggung jawab dan etis sangat penting untuk menghindari potensi penyalahgunaan dan bias.

- Versi yang berbeda memerlukan sumber daya komputasi yang berbeda pula, jadi penting untuk memilih versi yang tepat.

Sumber daya:

- Situs web Meta AI LLAMA: https://ai.meta.com/blog/large-bahasa-model-llama-meta-ai/

- Entri blog Meta AI di LLAMA2: https://ai.meta.com/blog/large-bahasa-model-llama-meta-ai/

- Kartu model LLAMA2 Wajah Memeluk: https://huggingface.co/models?search=llama

MEKAR LLM

Bloom LLM, yang lahir dari upaya kolaboratif komunitas global, telah menjadi kekuatan nyata dalam lanskap AI sumber terbuka. Berikut rincian lengkap fitur-fitur utamanya, potensi penerapannya, dan apa yang membuatnya unik:

Apa itu BLOOM LLM?

BLOOM adalah LLM multibahasa yang sangat besar, memiliki 176 miliar parameter dan dilatih dalam 46 bahasa dan 13 bahasa pemrograman. Dikembangkan melalui proyek kolaboratif selama setahun yang melibatkan Hugging Face dan peneliti dari lebih dari 70 negara, BLOOM mewujudkan semangat AI sumber terbuka.

Fitur Utama BLOOM:

- Keahlian Multibahasa : Menghasilkan teks yang koheren dan tepat dalam 46 bahasa, melampaui model khas Inggris-sentris.

- Akses Sumber Terbuka : Kode sumber dan data pelatihan tersedia untuk umum, mendorong transparansi dan peningkatan berbasis komunitas.

- Pembuatan Teks Autoregresif : Memperluas dan melengkapi urutan teks dengan mulus, menjadikannya ideal untuk berbagai tugas kreatif dan informatif.

- Jumlah Parameter Besar : Dengan 176 miliar parameter, BLOOM berada di antara LLM sumber terbuka terkuat, yang menawarkan kinerja unggul.

- Kolaborasi Global : Pengembangan model ini menunjukkan kekuatan kerja sama internasional dalam memajukan teknologi AI.

- Aksesibilitas Gratis : Siapa pun dapat mengakses dan memanfaatkan BLOOM melalui platform Hugging Face, mendemokratisasi akses ke alat AI mutakhir.

- Pelatihan Skala Industri : Dilatih pada data teks dalam jumlah besar menggunakan sumber daya komputasi yang signifikan, memastikan kinerja yang kuat.

Potensi Penerapan BLOOM:

- Komunikasi Multibahasa : Memfasilitasi komunikasi lintas budaya dengan menerjemahkan teks dan menghasilkan konten khusus bahasa.

- Penulisan Kreatif dan Pembuatan Konten : Membantu penulis dan seniman dalam berbagai format seperti puisi, naskah, kode, karya musik, dll.

- Pendidikan dan Penelitian : Personalisasikan pengalaman belajar, hasilkan materi pendidikan, dan dukung upaya penelitian di berbagai bidang.

- Bisnis dan Pemasaran : Tingkatkan layanan pelanggan dengan chatbot multibahasa, personalisasi kampanye pemasaran, dan analisis data secara efektif.

- Pengembangan AI Sumber Terbuka : Berfungsi sebagai landasan untuk penelitian dan pengembangan lebih lanjut dalam AI sumber terbuka, sehingga mendorong inovasi komunitas.

Apa yang membuat BLOOM unik?

- Fokus Multibahasa : Tidak seperti banyak LLM yang fokus pada bahasa Inggris, kemampuan multibahasa BLOOM membuka kemungkinan baru untuk komunikasi dan pemahaman global.

- Keterbukaan dan Transparansi : Akses publik terhadap kode dan data pelatihan memungkinkan partisipasi yang lebih luas dalam meningkatkan dan memanfaatkan model.

- Pengembangan Kolaboratif : Penciptaan model melalui kolaborasi global menunjukkan potensi AI sumber terbuka untuk menjembatani hambatan geografis dan budaya.

Keterbatasan dan Pertimbangan:

- Seperti semua LLM, BLOOM masih dalam pengembangan dan dapat menghasilkan keluaran yang tidak akurat atau bias. Penggunaan yang bertanggung jawab dan etis sangatlah penting.

- Memanfaatkan BLOOM secara efektif memerlukan pengetahuan teknis dan pemahaman tentang kemampuannya.

- Ukuran model yang besar mungkin memerlukan sumber daya komputasi yang signifikan untuk tugas-tugas tertentu.

Sumber daya:

- Situs web BigScience BLOOM: https://huggingface.co/bigscience/bloom-intermediate

- Kartu model Hugging Face BLOOM: https://bigscience.huggingface.co/blog/bloom

- Entri blog BigScience di BLOOM: https://huggingface.co/bigscience/bloom

- Repositori kartu model BLOOM di GitHub: https://github.com/bigscience-workshop/model_card

GPT-NeoX-20B

Ini adalah LLM sumber terbuka lainnya yang menjadi terkenal, menampilkan kemampuan dan potensi luar biasa. Berikut rincian fitur utamanya, kekuatan, dan potensi penerapannya:

Apa itu GPT-NeoX-20B?

- Dikembangkan oleh EleutherAI, GPT-NeoX-20B adalah model bahasa autoregresif dengan 20 miliar parameter yang dilatih pada Pile, kumpulan data teks dan kode yang sangat besar.

- Arsitekturnya meminjam dari GPT-3 tetapi dengan pengoptimalan yang signifikan untuk meningkatkan kinerja dan efisiensi.

- GPT-NeoX-20B unggul dalam beberapa bidang:

- Alasan yang sedikit : Berkinerja sangat baik pada tugas-tugas yang memerlukan pemahaman dan penerapan informasi dari contoh-contoh terbatas.

- Pembuatan teks bentuk panjang : Menghasilkan teks yang koheren dan benar secara tata bahasa bahkan untuk urutan yang panjang.

- Pembuatan dan analisis kode : Dapat memahami dan menghasilkan kode, membantu pengembang dalam berbagai tugas.

Kekuatan GPT-NeoX-20B:

- Sumber terbuka : Kode dan bobot model tersedia untuk umum, sehingga mendorong kontribusi dan penelitian komunitas.

- Pelatihan yang efisien : Memanfaatkan perpustakaan DeepSpeed untuk pelatihan yang efisien, membutuhkan lebih sedikit sumber daya komputasi dibandingkan dengan LLM lainnya.

- Pembelajaran beberapa langkah yang kuat : Berkinerja sangat baik pada tugas-tugas dengan data terbatas, sehingga dapat beradaptasi dengan beragam skenario.

- Pembuatan teks bentuk panjang : Menghasilkan teks yang koheren dan benar secara tata bahasa bahkan untuk rangkaian yang panjang, ideal untuk penulisan kreatif dan pembuatan konten.

- Pembuatan dan analisis kode : Memahami dan menghasilkan kode, yang berpotensi membantu pengembang dalam deteksi bug, penyelesaian kode, dan tugas lainnya.

Potensi Penerapan GPT-NeoX-20B:

- Asisten pribadi dan chatbot : Meningkatkan kemampuan mereka dalam memahami dan merespons pertanyaan dan permintaan kompleks.

- Penulisan kreatif dan pembuatan konten : Membantu penulis dan seniman dalam menghasilkan berbagai format kreatif seperti puisi, naskah, karya musik, dll.

- Pendidikan dan penelitian : Personalisasi pengalaman belajar, menghasilkan konten pendidikan, dan mendukung penelitian di berbagai bidang.

- Pengembangan perangkat lunak : Membantu pengembang dengan tugas-tugas seperti penyelesaian kode, deteksi bug, dan analisis kode.

- Penelitian AI sumber terbuka : Berfungsi sebagai landasan untuk penelitian dan pengembangan lebih lanjut dalam AI sumber terbuka, sehingga mendorong inovasi.

Keterbatasan dan Pertimbangan:

- Seperti semua LLM, GPT-NeoX-20B masih dalam pengembangan dan terkadang dapat menghasilkan keluaran yang tidak akurat atau bias. Penggunaan yang bertanggung jawab dan etis sangatlah penting.

- Memanfaatkan potensi penuhnya mungkin memerlukan pengetahuan teknis dan pemahaman tentang kemampuannya.

- Ukuran model mungkin memerlukan sumber daya komputasi yang signifikan untuk tugas tertentu.

Sumber daya:

- Repositori GitHub EleutherAI: Ini adalah repositori resmi untuk GPT-NeoX-20B, tempat Anda dapat menemukan kode sumber, skrip pelatihan, dan model terlatih. (Sumber: https://github.com/EleutherAI/gpt-neox)

- Kartu model Hugging Face: Kartu model Hugging Face memberikan gambaran menyeluruh tentang GPT-NeoX-20B, termasuk kemampuan, keterbatasan, dan hasil benchmarknya. (Sumber: https://huggingface.co/EleutherAI/gpt-neox-20b)

- Entri blog EleutherAI: Entri blog oleh EleutherAI ini memperkenalkan GPT-NeoX-20B, membahas arsitektur dan proses pelatihannya, serta menyoroti beberapa potensi penerapannya. (Sumber: https://www.opensourceforu.com/2022/04/eleutherai-releases-gpt-neox-20b-a-20-billion-parameter-ai-bahasa-model/)

MPT-7B

MPT-7B , kependekan dari MosesML Pretrained Transformer, adalah LLM sumber terbuka canggih yang dikembangkan oleh MosesML Foundations. Ia memiliki 7 miliar parameter dan dilatih pada kumpulan data besar sebanyak 1 triliun token, menjadikannya pesaing yang mampu dalam lanskap LLM. Berikut rincian fitur utama dan potensi penerapannya, serta beberapa sumber relevan untuk eksplorasi lebih lanjut:

Fitur Utama:

- Lisensi Komersial : Tidak seperti kebanyakan model sumber terbuka, MPT-7B dilisensikan untuk penggunaan komersial, sehingga membuka pintu bagi bisnis untuk memanfaatkan kemampuannya.

- Data Pelatihan yang Luas : Pelatihan MPT-7B pada kumpulan data beragam sebanyak 1 triliun token memastikan kinerja yang kuat dan kemampuan beradaptasi di berbagai tugas.

- Penanganan Input Panjang : Model ini dapat menangani input yang sangat panjang tanpa mengurangi akurasi, sehingga ideal untuk tugas seperti meringkas dokumen yang panjang.

- Kecepatan dan Efisiensi : Dioptimalkan untuk pelatihan dan inferensi cepat, MPT-7B memberikan hasil yang tepat waktu, penting untuk aplikasi dunia nyata.

- Kode Sumber Terbuka : Kode pelatihan sumber terbuka yang efisien dalam model ini mendorong transparansi dan memfasilitasi kontribusi komunitas terhadap pengembangannya.

- Keunggulan Komparatif : MPT-7B telah menunjukkan kinerja yang unggul dibandingkan model sumber terbuka lainnya dalam rentang parameter 7B-20B, bahkan menyamai kualitas LLaMA-7B.

Aplikasi Potensial:

- Analisis Prediktif : MPT-7B dapat menganalisis kumpulan data besar untuk mengidentifikasi pola dan tren, menginformasikan keputusan bisnis, dan mengoptimalkan operasi.

- Dukungan Pengambilan Keputusan : Model ini dapat membantu proses pengambilan keputusan yang kompleks dengan memberikan wawasan dan rekomendasi berdasarkan data yang dianalisis.

- Pembuatan dan Peringkasan Konten : MPT-7B dapat menghasilkan berbagai format teks kreatif seperti puisi, skrip, atau kode, atau merangkum dokumen panjang secara efektif.

- Chatbot Layanan Pelanggan : Dengan memahami bahasa dan konteks alami, MPT-7B dapat mendukung chatbot cerdas untuk meningkatkan pengalaman layanan pelanggan.

- Penelitian dan Pengembangan : Model dapat mendukung upaya penelitian di berbagai bidang dengan menganalisis data, menghasilkan hipotesis, dan membantu eksplorasi kreatif.

Sumber daya tambahan:

- Situs web MosaikML MPT-7B: https://www.mosaicml.com/blog/mpt-7b

- Kartu model Hugging Face MPT-7B: https://huggingface.co/mosaicml/mpt-7b

- Entri blog MosaikML di MPT-7B: https://www.mosaicml.com/blog/mpt-7b

Manfaatkan LLM OpenSource dengan Creole Studios

Model Bahasa Besar Opensource (LLM) membentuk kembali AI, menawarkan fleksibilitas dan inovasi untuk bisnis. Mereka hebat dalam menciptakan solusi teknologi baru dan memangkas biaya pengembangan. Namun, tantangan seperti privasi data dan penyesuaian untuk kebutuhan bisnis tertentu bisa jadi rumit.

Creole Studios adalah mitra ideal Anda dalam menghadapi tantangan ini. Keahlian kami dalam AI dan pembelajaran mesin berarti kami dapat membantu bisnis Anda memanfaatkan potensi penuh LLM sumber terbuka secara efisien dan aman. Kami fokus dalam menciptakan solusi khusus yang selaras dengan tujuan unik Anda, memastikan Anda tetap menjadi yang terdepan dalam lanskap AI yang berkembang pesat.

Bermitralah dengan Creole Studios untuk mengubah perjalanan AI Anda dengan kekuatan LLM sumber terbuka.